Entwicklung großer Sprachmodelle

Wichtigste Ergebnisse

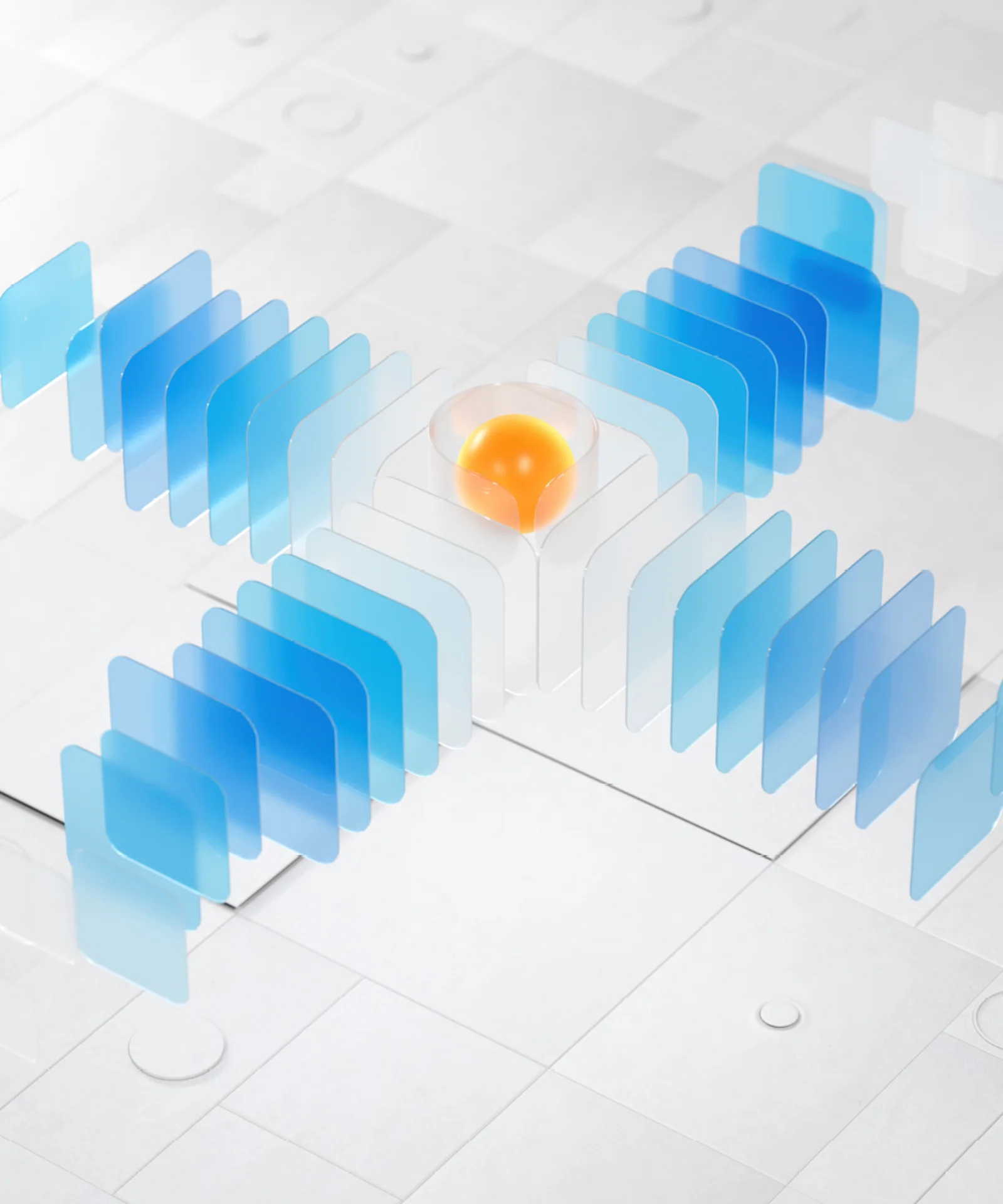

Die Technologie für die Entwicklung und das Hosting von großen Sprachmodellen (LLM) hat sich weiterentwickelt und verbreitet, so dass sie nun allgemein zugänglich ist.

Unsere Untersuchungen und Experimente zeigen, dass es jetzt für praktisch jedes Unternehmen möglich ist, Modelle zu hosten und anzupassen, die dem neuesten Stand der Technik entsprechen. Die Kosten sind jedoch so hoch, dass es nicht realistisch ist, Open-Source-Modelle in vollem Umfang zu Preisen anzubieten, die mit den Hyperscale-Anbietern wettbewerbsfähig sind.

In diesem Beitrag wird gezeigt, was mit handelsüblicher Hardware möglich ist, und es werden die Auswirkungen des Wandels in der KI-Technologie erörtert, der diese Demonstration ermöglicht hat.

Es werdendrei Zukunftsperspektiven für die KI-Technologie beschrieben:

- eine Zukunft, in der der Umfang dominiert,

- eine Zukunft, in der Größe wichtig ist,

- und eine Zukunft, in der der Umfang irrelevant ist.

Gegenwärtig deutet alles auf eine Zukunft hin, in der die Größe eine Rolle spielt, und nicht auf eine Zukunft, in der die Größe dominiert, aber es gibt auch Anzeichen dafür, dass die Größe noch weniger wichtig sein könnte. Laden Sie unser Whitepaper herunter, um mehr darüber zu erfahren, wie es für praktisch jedes Unternehmen möglich ist, nahezu hochmoderne Modelle zu hosten und anzupassen

FAQ: Entwicklung von Enterprise-LLM

Was ist Modelldestillation bei der Entwicklung großer Sprachmodelle?

Modelldestillation ist eine Technik, bei der ein kleineres „Schüler”-Modell trainiert wird, um das Verhalten eines größeren „Lehrer”-Sprachmodells (LLM) nachzuahmen. Dadurch werden die Modellgröße und die Rechenanforderungen reduziert, während die ursprüngliche Leistung weitgehend erhalten bleibt.

In Unternehmensumgebungen ermöglicht die Modelldestillation eine kosteneffiziente Bereitstellung von LLMs auf einer mittelgroßen GPU-Infrastruktur statt auf Hyperscale-Clustern. In Kombination mit Quantisierung und parameter-effizienter Abstimmung senkt sie die Inferenzkosten und die Latenz erheblich. Die Destillation ist besonders wertvoll für domänenspezifische Anwendungen, bei denen keine extrem großen Modelle erforderlich sind.

Der vollständige Thought Leadership-Bericht erklärt, wie die Destillation die Wirtschaftlichkeit der LLM-Infrastruktur und die KI-Strategie von Unternehmen verändert. Laden Sie den Bericht herunter, um Benchmarks und Einblicke in die Implementierung zu erhalten.

Was ist der Unterschied zwischen Modelldestillation und Quantisierung?

Modelldestillation und Quantisierung sind beides LLM-Optimierungstechniken, die jedoch unterschiedliche Aspekte der Effizienz betreffen. Durch Destillation wird die Modellgröße reduziert, indem ein kleineres Modell trainiert wird, um ein größeres Modell zu imitieren. Durch Quantisierung wird der Speicherbedarf reduziert, indem die numerische Genauigkeit verringert wird (z. B. von 16 Bit auf 8 Bit).

Die Destillation verändert die Modellarchitektur und die Anzahl der Parameter, während die Quantisierung die Darstellung der Parameter modifiziert. In Kombination können diese Techniken die GPU-Anforderungen und die Inferenzkosten erheblich reduzieren, ohne die Leistung wesentlich zu beeinträchtigen.

Der Thought Leadership untersucht, wie die Kombination von Destillation und Quantisierung eine nahezu branchenführende Leistung auf zugänglicher Hardware ermöglicht. Laden Sie das vollständige Dokument herunter, um technische Benchmarks zu erhalten.

Ist der Aufbau eines privaten LLM rentabler als die Verwendung API-basierter Modelle?

Der Aufbau eines privaten LLM kann bei großem Umfang rentabler sein, insbesondere bei anhaltenden Workloads mit hohem Token-Volumen und strengen Anforderungen an die Datenverwaltung. Die Gesamtbetriebskosten hängen jedoch von der Infrastruktur, dem technischen Fachwissen und den Auslastungsraten ab.

API-basierte Modelle bieten eine schnelle Bereitstellung und Flexibilität, aber die langfristigen Nutzungsgebühren können die Kosten für den Betrieb eines fein abgestimmten, selbst gehosteten Modells übersteigen. Unternehmen müssen die GPU-Investitionskosten, die MLOps-Reife, das Compliance-Risiko und die strategische Differenzierung bewerten.

Der vollständige Bericht vergleicht API-Preisszenarien mit selbst gehosteten und destillierten Modellstrategien unter verschiedenen Nutzungsannahmen. Laden Sie die Analyse für eine detaillierte Kostenmodellierung herunter.

.webp)