15 fev. 2022

Neurônios Artificiais – Modelo Perceptron

Nas últimas semanas, publicamos o primeiro artigo da série de conteúdos sobre neurônio artificial. Hoje, vamos ver com um pouco mais de detalhes, ainda dentro do modelo perceptron, como um neurônio artificial deveria aprender a partir de um conjunto de dados.

Nysio Chrysostomo

Cientista de Dados I

blogAbstractMinutes

blogAbstractTimeReading

Intersetorial

DevOps

IA

contact

share

Na segunda parte da série sobre Neurônios Artificiais, explicamos o modelo perceptron e como ele funciona, com base em IA (Inteligência Artificial) e aprendizagem de máquina.

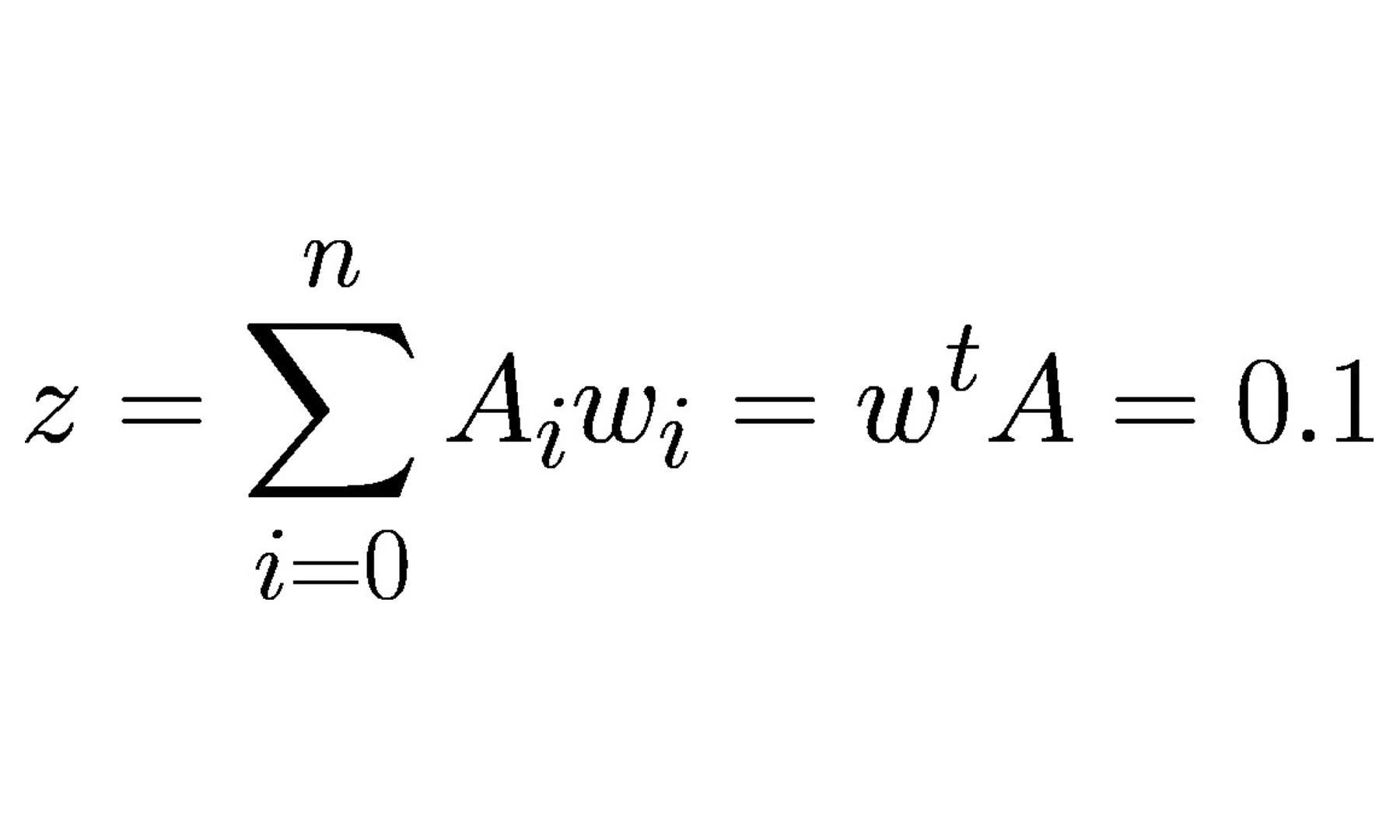

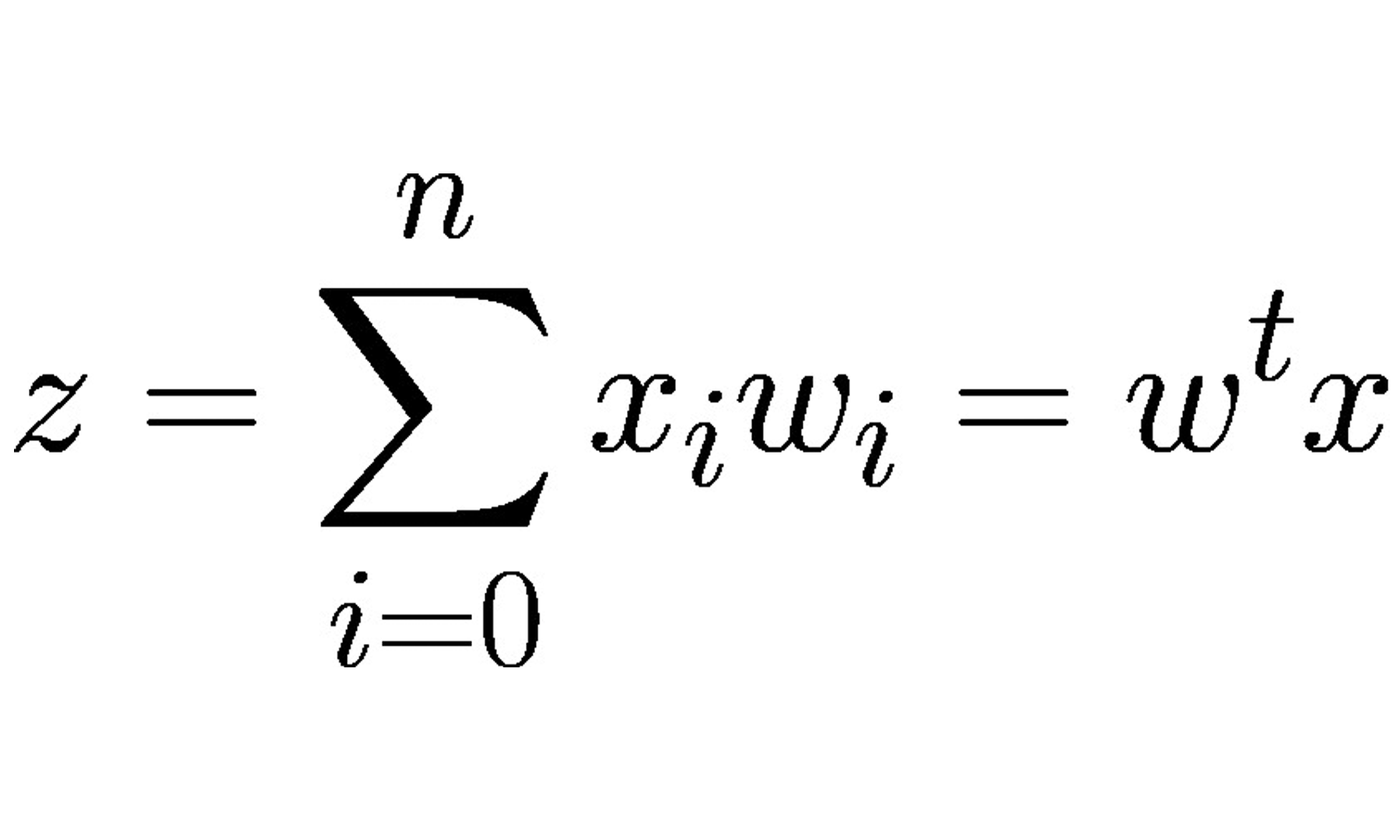

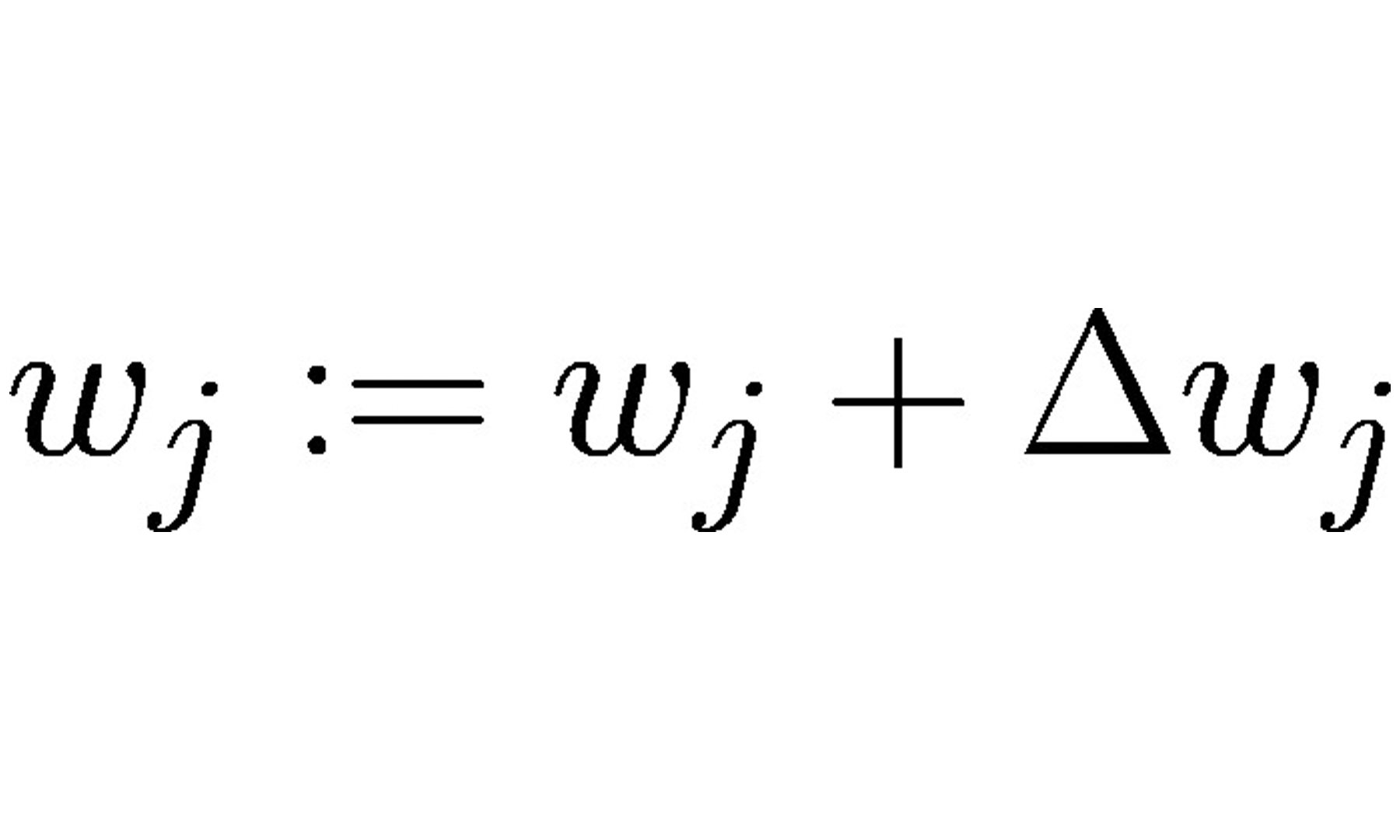

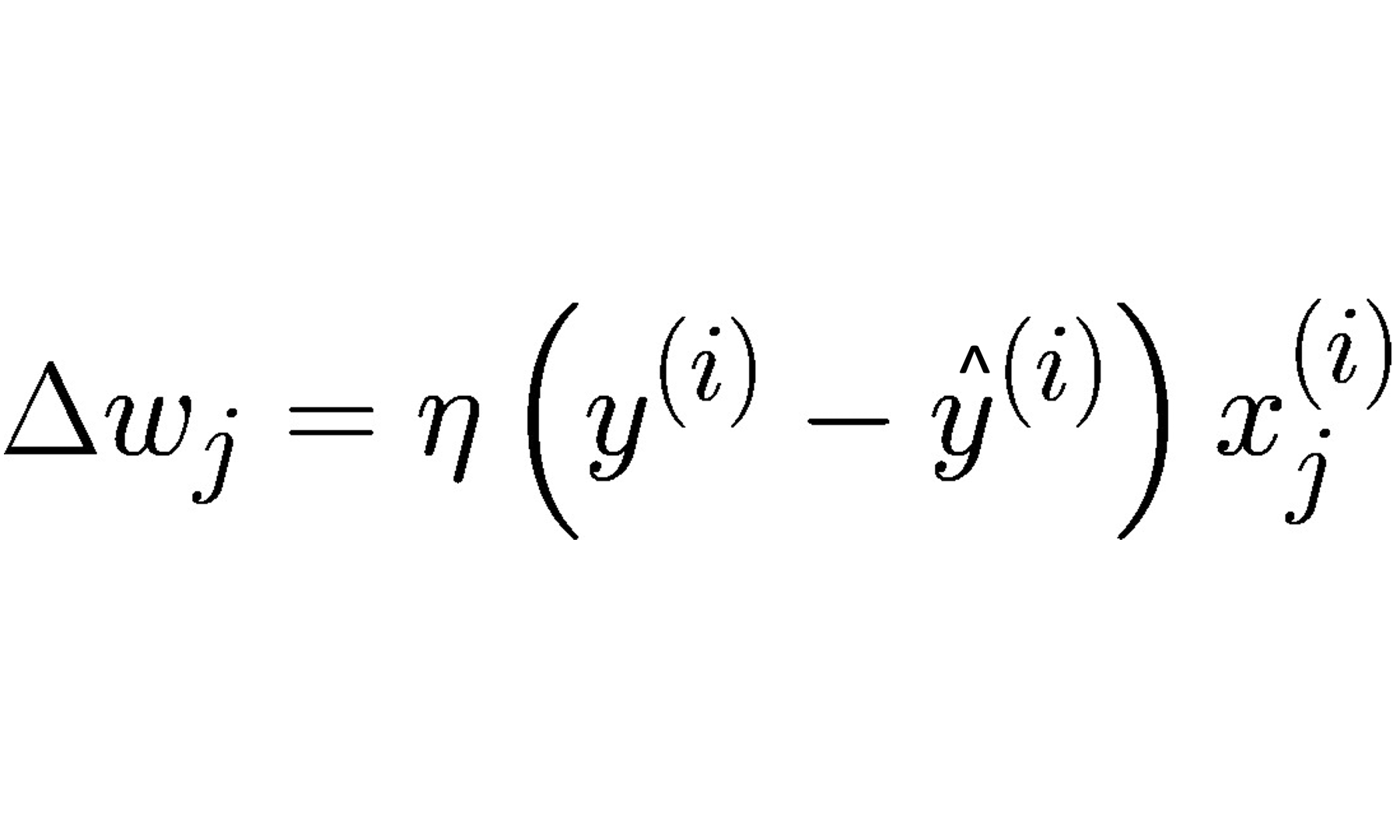

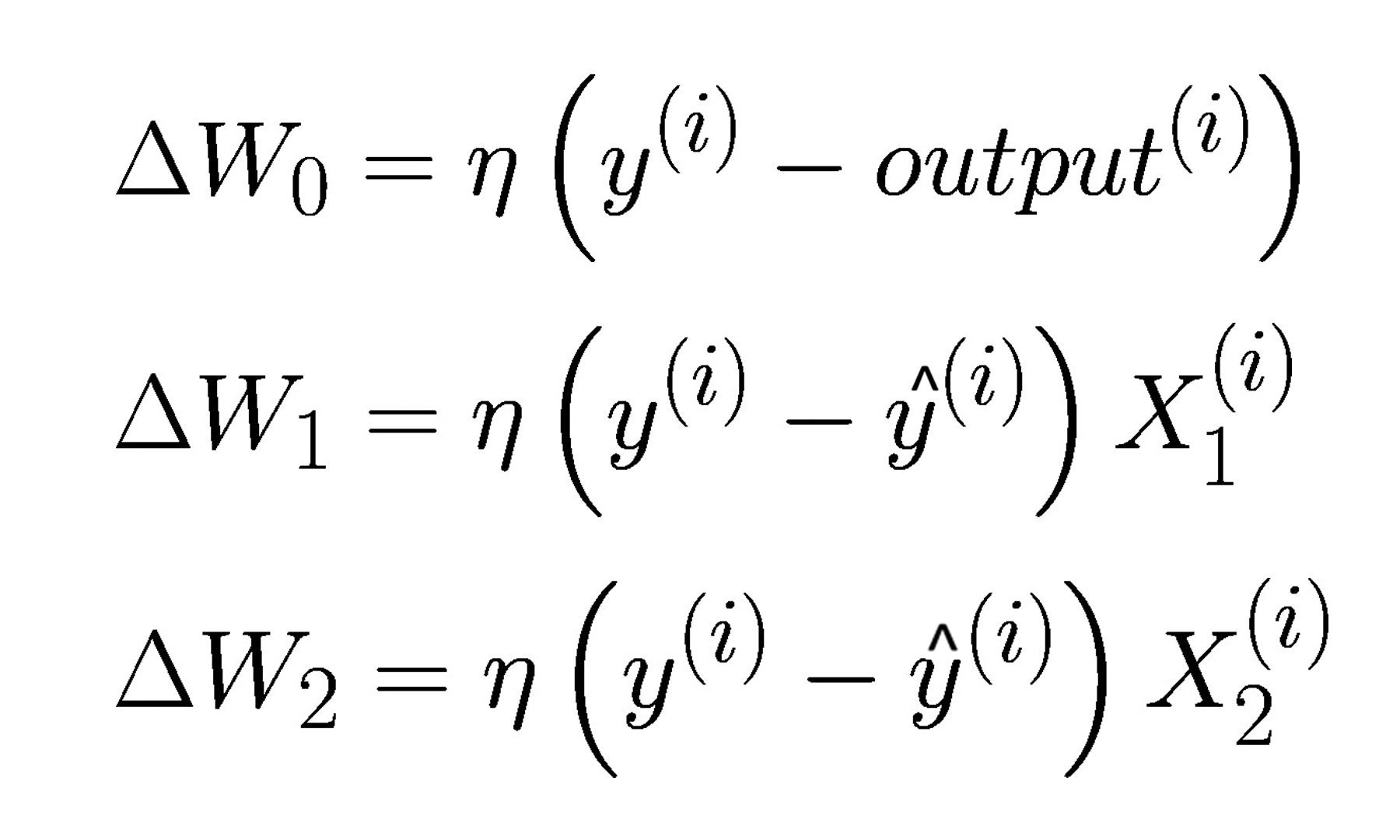

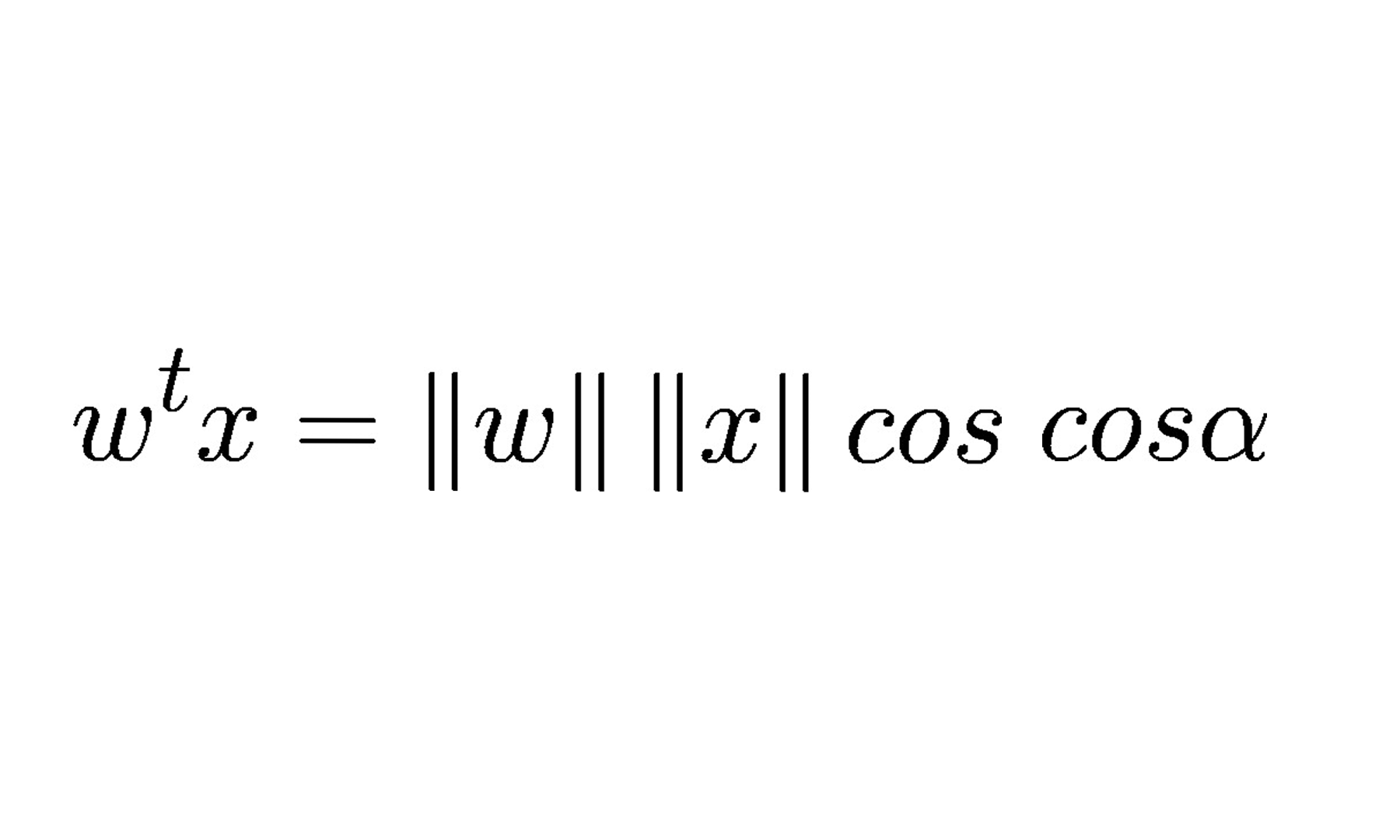

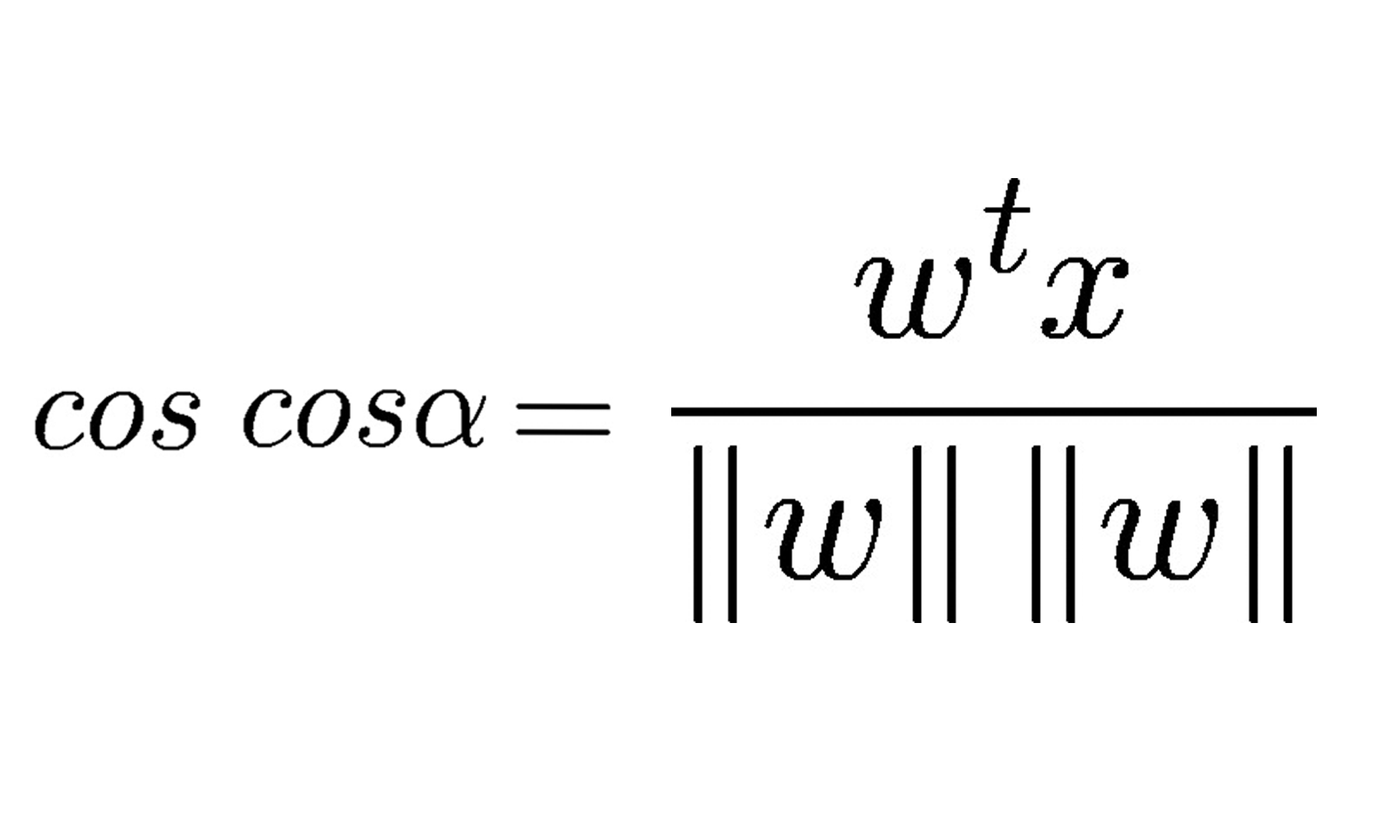

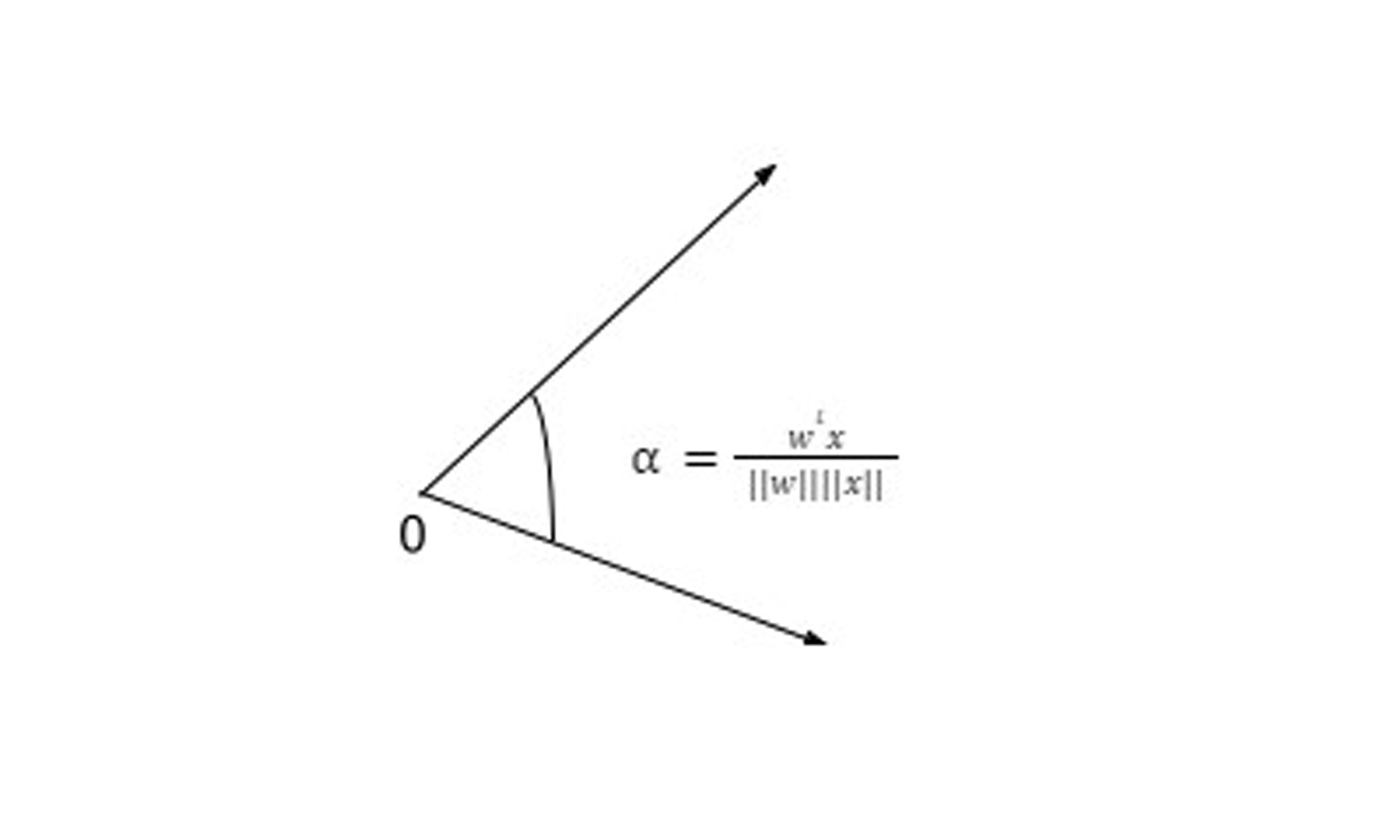

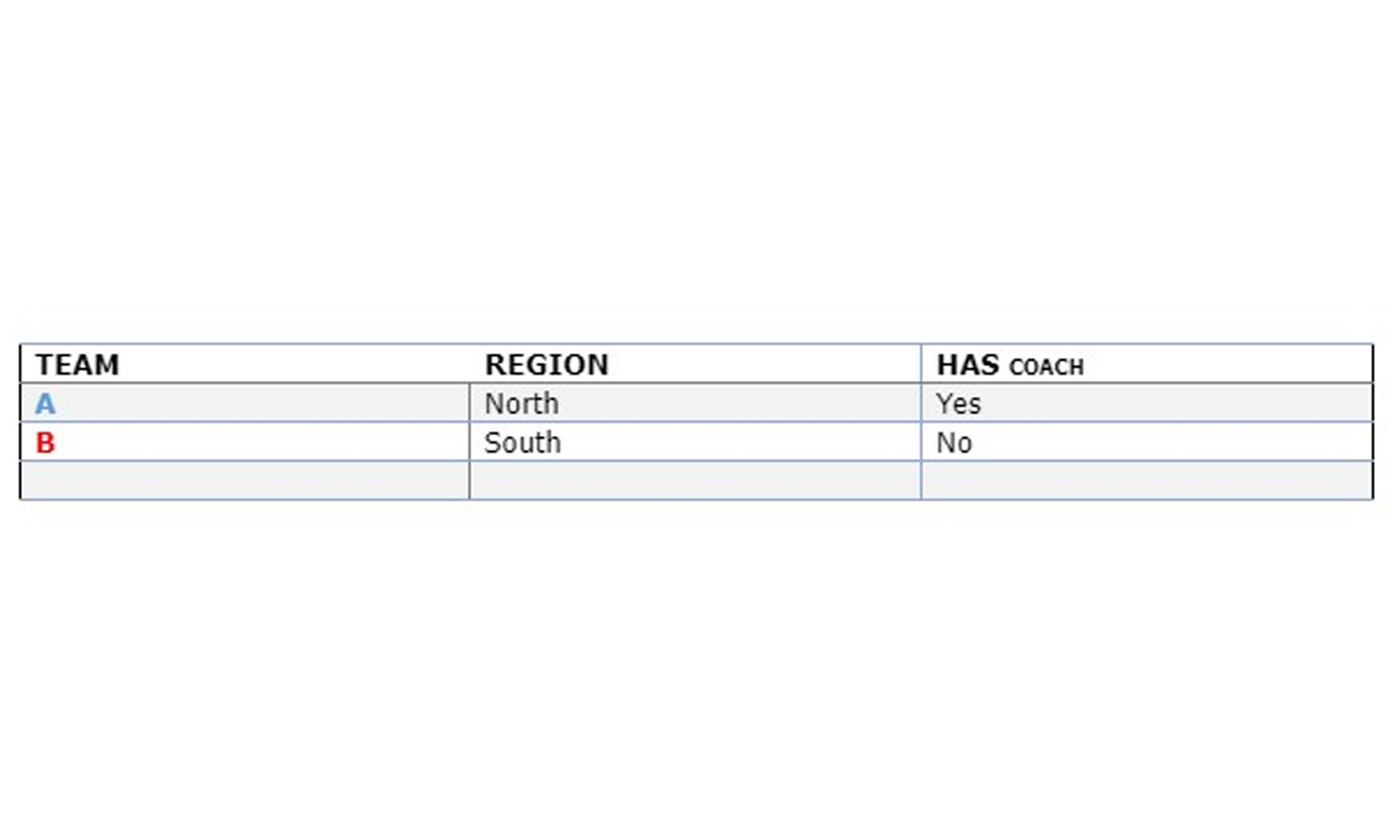

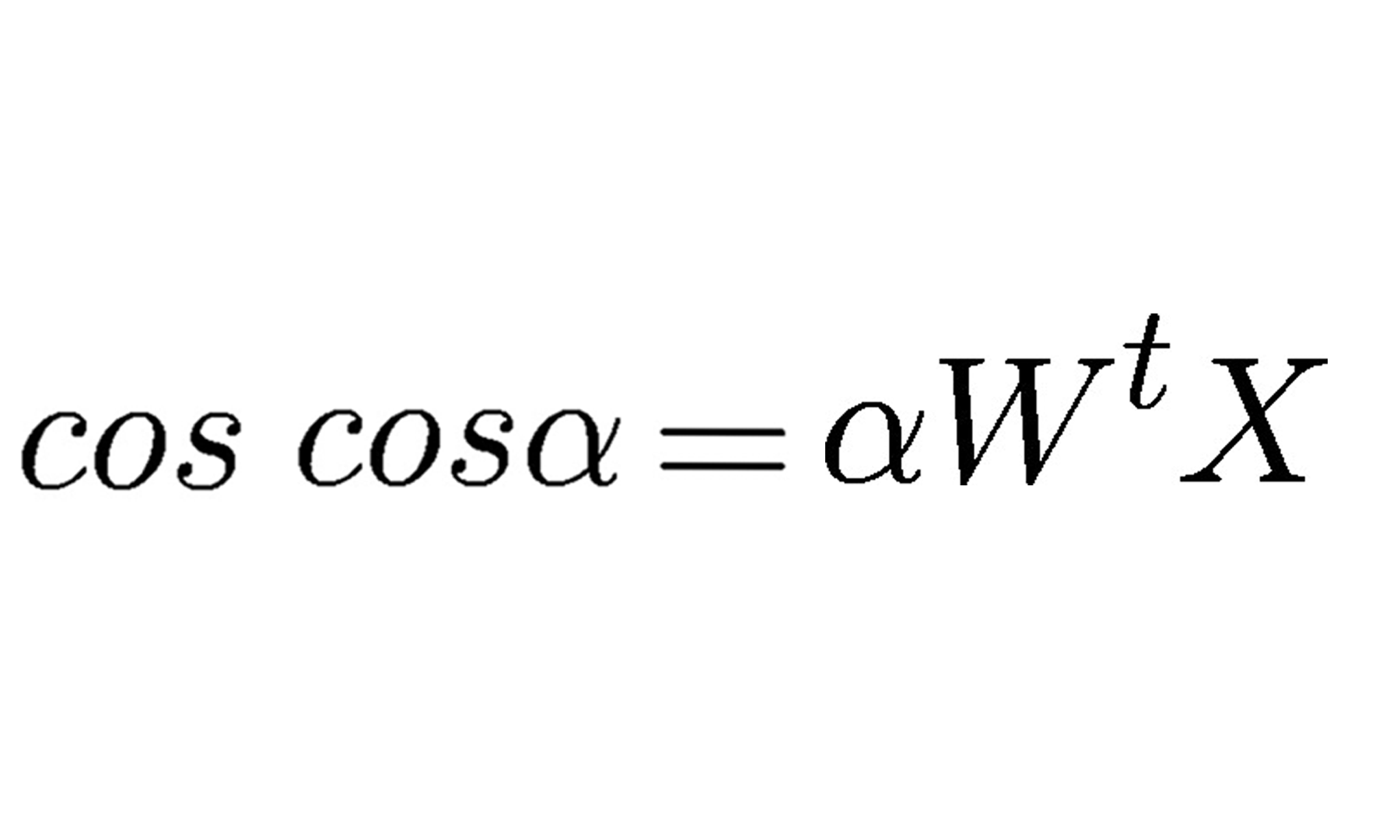

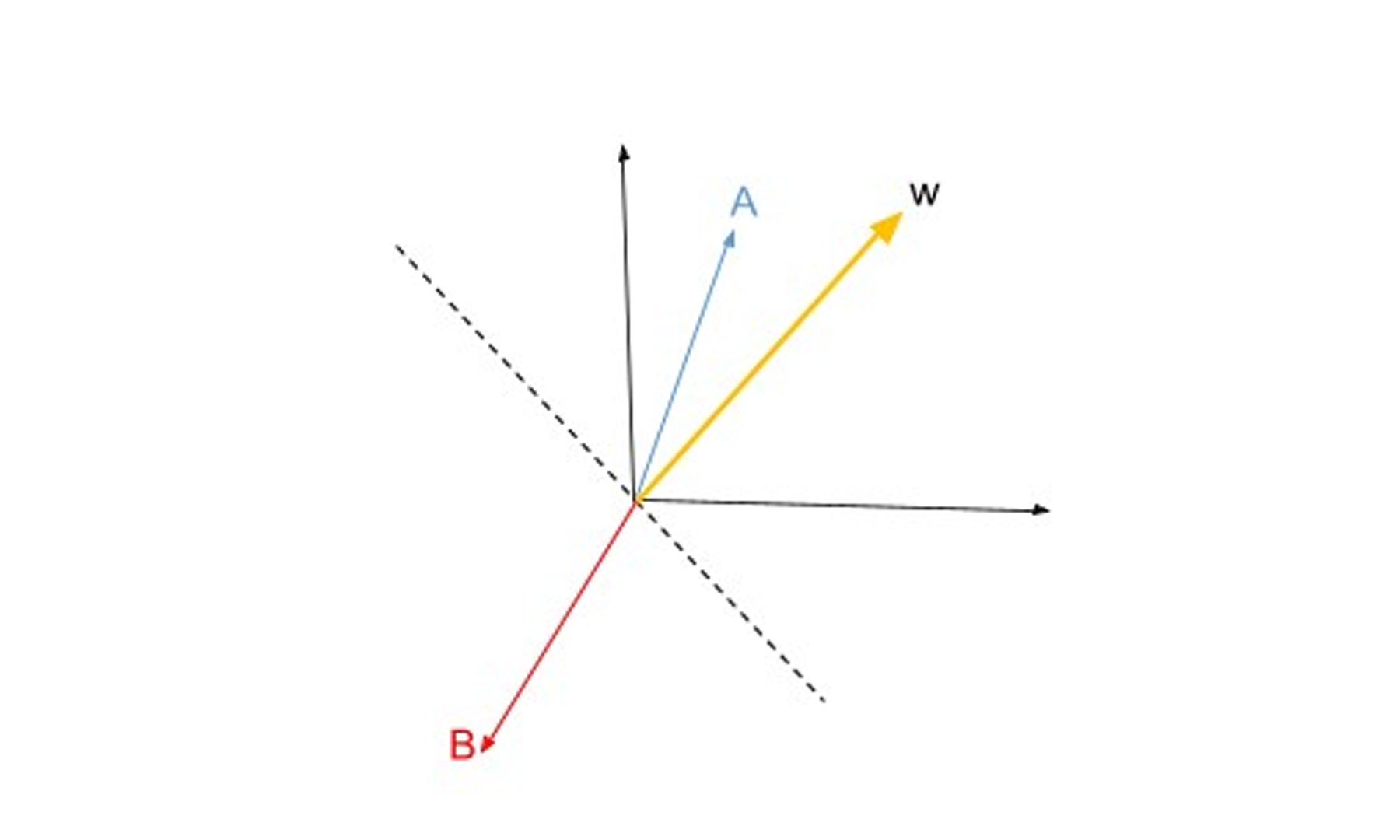

Continuando com o modelo de neurônio artificial, na visão de McCulloch-Pitts (MCP) e o limiar introduzido por Rosenblatt, vamos agora tratar da regra de aprendizagem dessa tecnologia. Podemos pensar que se trata de uma aproximação reduzida para simular como um neurônio biológico funciona dentro do cérebro, ou seja, se o neurônio vai ou não disparar um sinal de saída.

![GFT Blog: Neuronios Artificiais Modelo Perceptron 9 Mathematical notation showing vector A as [1 1] and vector B as [-1 -1].](/dam/jcr:28fe7802-2a06-4a68-98a6-9b3d7e631bdb/gft-image-blog-neuronios-artificiais-modelo-perceptron-9.png)

![GFT Blog: Neuronios Artificiais Modelo Perceptron 12 Mathematical notation showing vector W defined as [-0.1, 0.1, 0.1].](/dam/jcr:5ce714e1-75b4-412e-b88e-f9c604027058/gft-image-blog-neuronios-artificiais-modelo-perceptron-12.png)

![GFT Blog: Neuronios Artificiais Modelo Perceptron 13 Mathematical notation showing vector A defined as [1, 1, 1].](/dam/jcr:c51f58b3-0381-4120-926f-39ce0f245247/gft-image-blog-neuronios-artificiais-modelo-perceptron-13.png)